DeepSeek R1 로컬 사용법 | Ollama 설치부터 API 연동까지 완벽 가이드

인공지능 기술이 빠르게 발전하면서, DeepSeek R1은 그 중에서도 주목받는 AI 모델로 자리 잡았습니다. 이 글에서는 DeepSeek R1 사용법에 대해 로컬 설치부터 API 연동, 그리고 Ollama와 LLM을 활용한 확장까지 상세히 다룹니다. 이 가이드는 DeepSeek R1을 처음 접하는 사용자부터 고급 사용자까지 모두에게 유용한 정보를 제공합니다.

DeepSeek R1 소개

DeepSeek R1은 오픈소스 기반의 고급 AI 모델로, 수학, 코딩, 논리적 문제 해결 등 다양한 작업에서 뛰어난 성능을 자랑합니다. 특히, OpenAI의 고가 모델에 비해 무료로 사용할 수 있다는 점에서 많은 주목을 받고 있습니다.

주요 기능과 특징

- 오픈소스 및 무료 사용: DeepSeek R1은 MIT 라이선스를 통해 누구나 자유롭게 사용할 수 있습니다.

- 로컬 설치 가능: Ollama와 같은 툴을 통해 로컬에서 실행 가능하며, 데이터 프라이버시를 보장합니다.

- 다양한 모델 크기 지원: 1.5B부터 70B까지 다양한 크기의 모델을 제공하여 사용자의 하드웨어에 맞게 선택 가능합니다.

DeepSeek R1이 필요한 이유

- 비용 절감: OpenAI의 모델에 비해 월 구독료가 없으며, API 비용도 저렴합니다.

- 데이터 보안: 로컬에서 실행 시 데이터가 외부 서버로 전송되지 않아 보안이 강화됩니다.

- 확장성: Ollama 및 LLM과의 통합을 통해 다양한 활용이 가능합니다.

DeepSeek R1 로컬 설치 가이드

DeepSeek R1을 로컬에서 설치하면 데이터 보안과 비용 절감의 이점을 누릴 수 있습니다. 아래는 설치 과정에 대한 상세 가이드입니다.

설치 전 준비물 및 요구사항

- 운영체제: Windows, macOS, Linux 지원

- 하드웨어:

- 최소 8GB RAM (1.5B 모델 기준)

- NVIDIA GPU 권장 (7B 이상 모델 사용 시)

- 필요 소프트웨어:

- Docker

- Ollama

설치 단계별 가이드

1. 소프트웨어 다운로드 및 설치

-

Ollama 설치:

curl -fsSL https://ollama.com/install.sh | sh설치 후 버전을 확인합니다:

ollama -v

2. DeepSeek R1 모델 다운로드

- Ollama를 통해 모델 다운로드:

ollama pull deepseek-r1

3. 환경 설정 및 초기 구성

- Docker를 사용하여 Open Web UI 설치:

브라우저에서

docker run -d -p 3000:8080 \

--add-host=host.docker.internal:host-gateway \

-v open-webui:/app/backend/data \

--name open-webui \

--restart always \

ghcr.io/open-webui/open-webui:mainhttp://localhost:3000으로 접속하여 DeepSeek R1을 선택합니다.

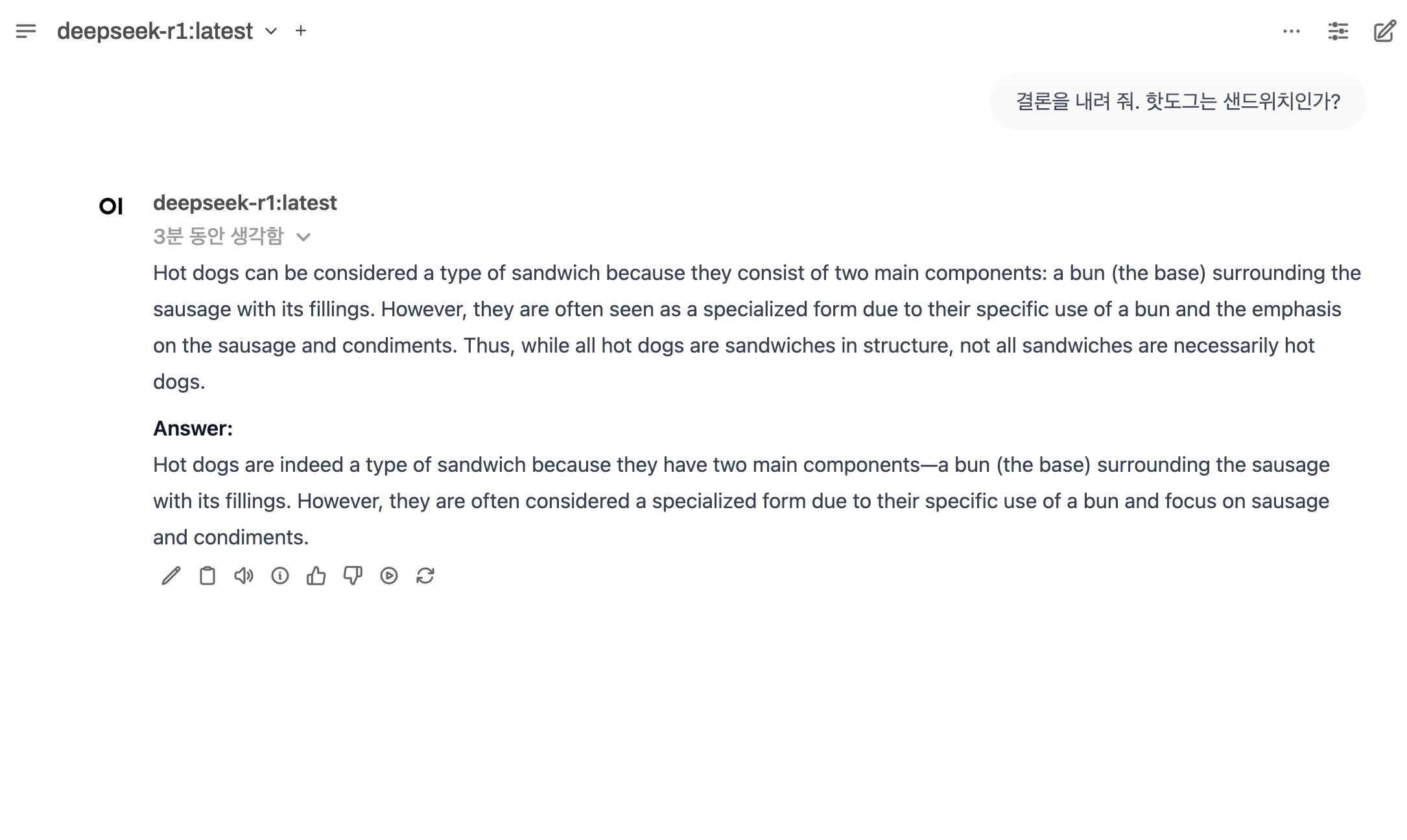

아래와 같이 답변 해주는것을 확인 할 수 있습니다.

참고로 DeepSeek R1의 경우 답변 속도가 느리고 한글 답변이 잘 안되니 참고 바랍니다.

설치 시 자주 발생하는 문제와 해결 방법

- 모델 다운로드 속도 느림: 인터넷 연결 상태를 확인하거나 작은 모델(1.5B)을 먼저 다운로드하세요.

- Docker 실행 오류: Docker가 최신 버전인지 확인하고, 권한 문제를 해결하세요.

DeepSeek R1 API 연동 방법

API 연동은 DeepSeek R1을 프로젝트에 통합하여 활용도를 극대화할 수 있는 방법입니다.

API 연동의 필요성 및 장점

- 자동화: API를 통해 DeepSeek R1을 다양한 애플리케이션에 통합 가능

- 확장성: 클라우드 기반 API를 사용하여 대규모 작업 처리 가능

API 키 발급 및 설정 방법

- DeepSeek 플랫폼에 접속하여 ��계정을 생성합니다.

- API 키를 발급받아 환경 변수에 저장합니다:

export DEEPSEEK_API_KEY="your_api_key"

API 연동 예제 코드

Python을 활용한 기본 연동

import openai

client = openai.Client(

base_url="https://api.deepseek.com/v1",

api_key="your_api_key"

)

response = client.chat.completions.create(

model="deepseek-reasoner",

messages=[{"role": "user", "content": "Explain blockchain security"}]

)

print(response)

실제 프로젝트에서의 활용 사례

- 데이터 분석 자동화

- 고객 지원 챗봇 개발

API 연동 시 주의사항

- 요금 관리: API 호출 빈도를 조절하여 비용을 절감하세요.

- 보안: API 키를 안전하게 보관하고, 공개 저장소에 업로드하지 마세요.

DeepSeek API 활용 방법이 궁금하다면

DeepSeek 플랫폼 바로가기참고로 현재 서비스가 불안정 하여 접속이 잘 안되는 경우도 있으니 참고 바랍니다.

마치며

이 가이드는 DeepSeek R1을 로컬에서 설치하고 API 연동하는 방법 까지 다루었습니다. 이 가이드를 통해 DeepSeek R1을 활용하여 더욱 효과적인 프로젝트를 진행할 수 있을 것입니다.